Meta ha recentemente introdotto una nuova funzionalità per i suoi occhiali smart Ray-Ban Meta, ora disponibile anche in Italia. Questa innovazione, nota come “AI visiva” o “Meta AI with Vision”, consente agli utenti di interagire con il mondo circostante attraverso domande dirette riguardo a ciò che stanno osservando o fotografando. La novità è stata comunicata tramite un popup nell’app Meta AI, suscitando l’interesse degli utenti.

Funzionalità della AI visiva

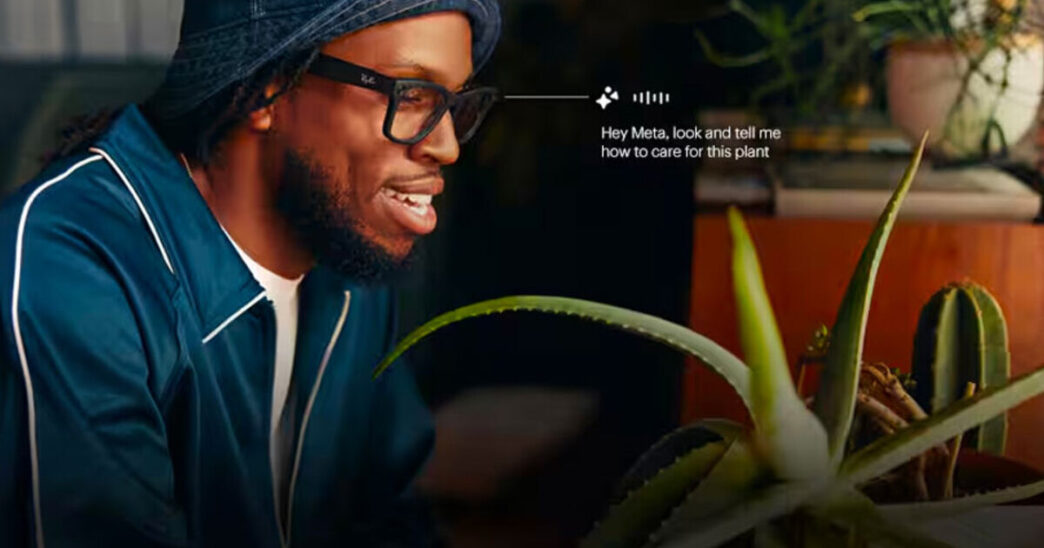

La funzione principale di questa tecnologia è la possibilità di porre domande vocali agli occhiali riguardo a immagini catturate. Ad esempio, gli utenti possono chiedere: “Hey Meta, cosa sto guardando?” oppure formulare richieste più specifiche. L’intelligenza artificiale analizza le foto scattate e fornisce risposte pertinenti in tempo reale.

Questa capacità offre una serie di applicazioni pratiche. Gli utenti possono identificare monumenti storici semplicemente scattando una foto e ponendo la domanda corretta. Inoltre, è possibile tradurre testi presenti su cartelli stradali o ottenere informazioni dettagliate su opere d’arte esposte nei musei. Anche il riconoscimento delle razze animali diventa immediato grazie a questa tecnologia avanzata.

Leggi anche:

L’obiettivo principale è rendere l’interazione con l’ambiente più ricca e informativa, permettendo alle persone di apprendere mentre esplorano il mondo intorno a loro. Questo approccio si allinea con le tendenze attuali nel campo della tecnologia indossabile e dell’intelligenza artificiale.

Come funziona la tecnologia

Il funzionamento della nuova feature si basa sull’elaborazione dei dati visivi attraverso l’intelligenza artificiale sviluppata da Meta. Quando un utente scatta una foto utilizzando i Ray-Ban Meta e pone una domanda relativa all’immagine appena catturata, il sistema utilizza LLama 3.2 per analizzare il contenuto visuale.

LLama 3.2 è un modello multimodale che permette all’AI non solo di interpretare le immagini ma anche di fornire risposte vocali tramite gli altoparlanti integrati negli occhiali stessi. Per utilizzare questa funzione innovativa, gli utenti devono avere installato sul proprio smartphone l’applicazione Meta AI e assicurarsi che sia correttamente configurata per il collegamento ai dispositivi indossabili.

È importante notare che tutto questo processo avviene nel cloud; pertanto le immagini vengono elaborate in modo leggero per garantire rapidità nelle risposte senza compromettere la qualità del servizio offerto.

Privacy e sicurezza dei dati

Meta ha dichiarato che gestisce i dati personali degli utenti con grande attenzione alla privacy. Le richieste fatte dagli utenti insieme alle fotografie sono trattate seguendo rigorosi protocolli per garantire la sicurezza delle informazioni sensibili.

Nonostante ciò, resta da considerare che alcune domande poste agli occhiali potrebbero non comportare rischi significativi dal punto di vista della privacy; ad esempio chiedere informazioni generiche sulla torre Eiffel o sulla ricetta del dolce osservato non solleva preoccupazioni rilevanti sotto questo aspetto.

Con queste nuove funzioni integrate nei Ray-Ban Meta, si apre un nuovo capitolo nell’interazione tra uomo e tecnologia portatile; sarà interessante osservare come gli utenti adotteranno queste innovazioni nella vita quotidiana.