Meta, la società madre di Facebook e Instagram, è al centro di una controversia riguardante la gestione dei contenuti deepfake generati dall’intelligenza artificiale. Questi video manipolano volti e voci di celebrità famose per scopi fraudolenti, creando truffe che ingannano gli utenti. L’Oversight Board, un organismo composto da esperti internazionali incaricato di monitorare i contenuti sulla piattaforma, ha espresso preoccupazione per l’inefficienza delle misure adottate da Meta nel contrastare questo fenomeno.

La proliferazione dei deepfake su Facebook e Instagram

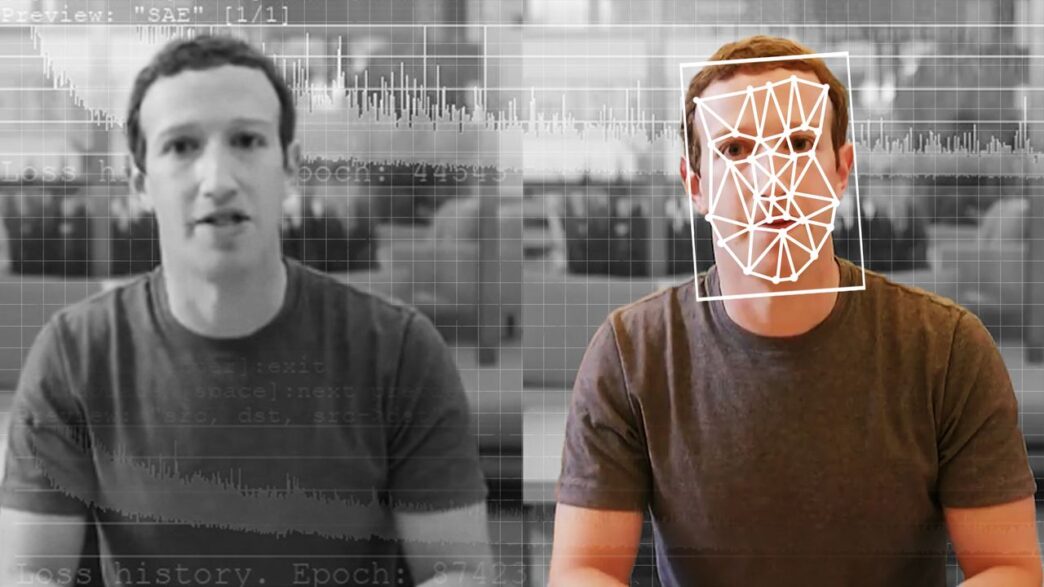

Negli ultimi anni, i deepfake sono diventati una presenza costante sui social media. Celebrità come Ronaldo il Fenomeno e Cristiano Ronaldo sono stati utilizzati in video promozionali per casinò online o app che promettono guadagni facili. Altri volti noti come Tom Hanks e Mark Zuckerberg compaiono in pubblicità ingannevoli relative a cure dentali o investimenti in criptovalute. Questi contenuti non solo sfruttano le immagini delle celebrità senza consenso ma spesso rimangono online anche dopo numerose segnalazioni da parte degli utenti.

L’Oversight Board ha evidenziato come molti iscritti a Facebook e Instagram non siano sufficientemente esperti per riconoscere questi video falsi, cadendo così nelle trappole orchestrate dai truffatori. La situazione è allarmante: gli utenti possono essere deprivati dei loro dati sensibili o spinti a pagare servizi inesistenti basandosi su queste false rappresentazioni.

Nonostante le segnalazioni crescenti da parte della comunità degli utenti, Meta sembra non aver implementato misure adeguate per affrontare il problema con sufficiente rapidità ed efficacia. Il board ha affermato che “i moderatori su larga scala non hanno il potere di far rispettare questo divieto” contro i contenuti che creano false identità al fine di frodare gli utenti.

La risposta di Meta alle critiche dell’Oversight Board

In risposta alle accuse mosse dall’Oversight Board, un portavoce di Meta ha cercato di minimizzare le preoccupazioni espresse dal gruppo esperto definendole “inaccurate”. Secondo quanto dichiarato dalla società, le protezioni attuate stanno evolvendo insieme alle minacce emergenti nel panorama digitale. Il portavoce ha sottolineato l’importanza della tecnologia avanzata nella lotta contro le frodi online.

Meta sta testando sistemi basati sul riconoscimento facciale con l’obiettivo dichiarato di migliorare la sicurezza sulla piattaforma. Inoltre, vengono forniti strumenti agli utenti affinché possano proteggersi meglio dalle truffe attraverso avvisi specifici e opzioni dedicate alla sicurezza del profilo personale.

Tuttavia, resta evidente che ci sia bisogno urgente d’interventi più incisivi nella moderazione dei contenuti pubblicati sulle piattaforme social dell’azienda. Con lo sviluppo continuo delle tecnologie utilizzate nella creazione dei deepfake – sempre più sofisticate ed indistinguibili dalla realtà – è fondamentale che Meta adotti strategie più efficaci per tutelare i propri iscritti dalle insidie rappresentate da tali pratiche fraudolente.

La questione solleva interrogativi importanti sul ruolo delle grandi aziende tecnologiche nella protezione degli utenti dai rischi associati all’uso improprio dell’intelligenza artificiale nei contesti digitali quotidiani.